Основы технологии CUDA. Работа с памятью презентация

Содержание

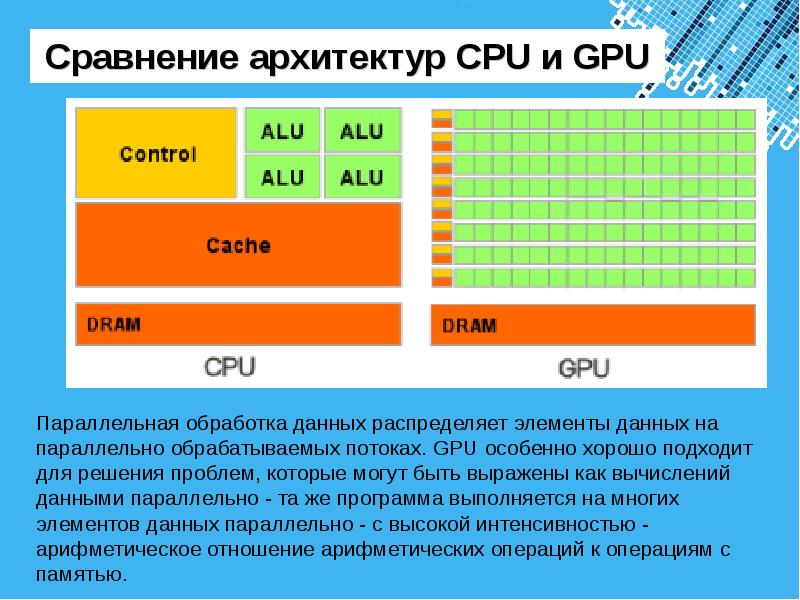

- 2. Сравнение архитектур CPU и GPU Параллельная обработка данных распределяет элементы данных

- 3. Вычислительная модель GPU Двумерная блочная структура

- 4. Структура блоков Трехмерная структура блоков

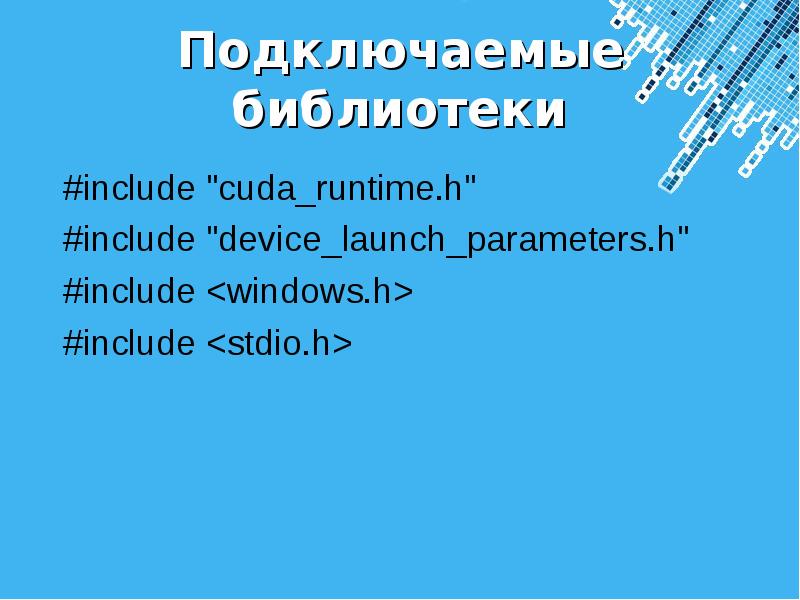

- 5. Подключаемые библиотеки #include "cuda_runtime.h" #include "device_launch_parameters.h" #include <windows.h> #include <stdio.h>

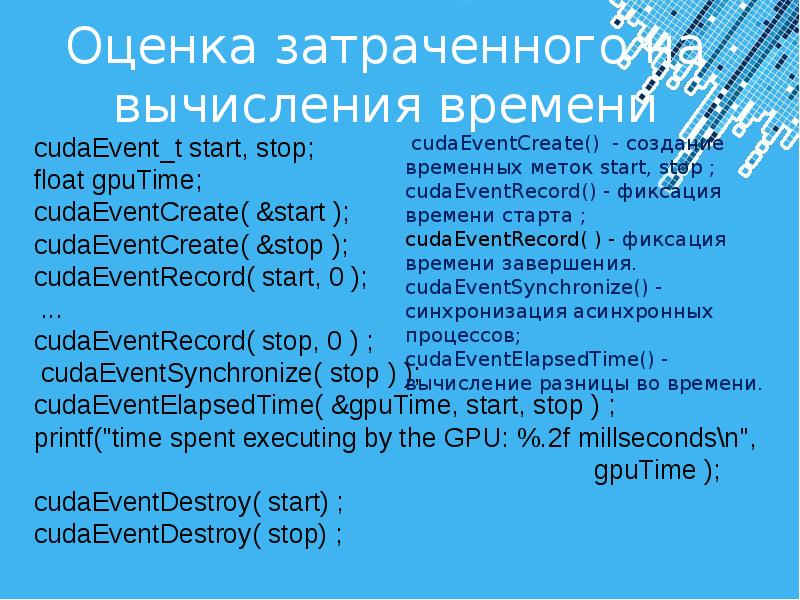

- 6. Оценка затраченного на вычисления времени cudaEvent_t start, stop; float gpuTime;

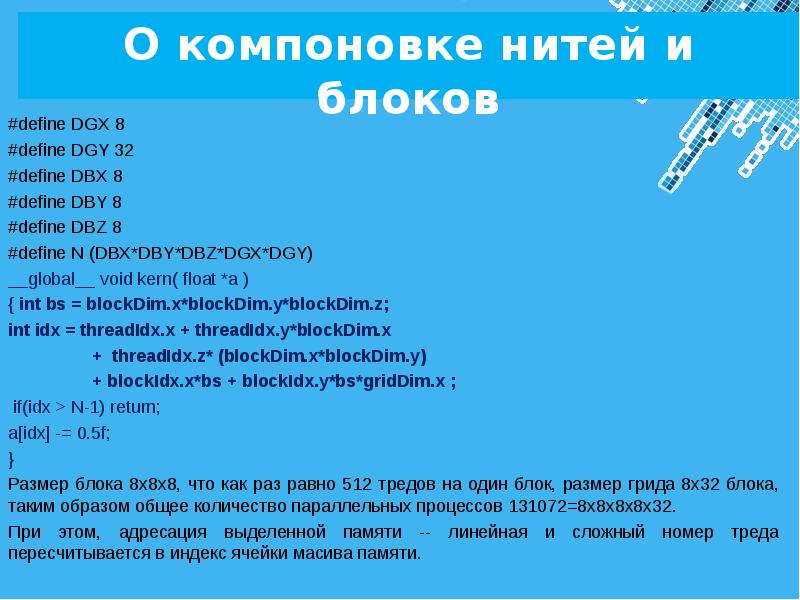

- 7. О компоновке нитей и блоков #define DGX 8 #define DGY

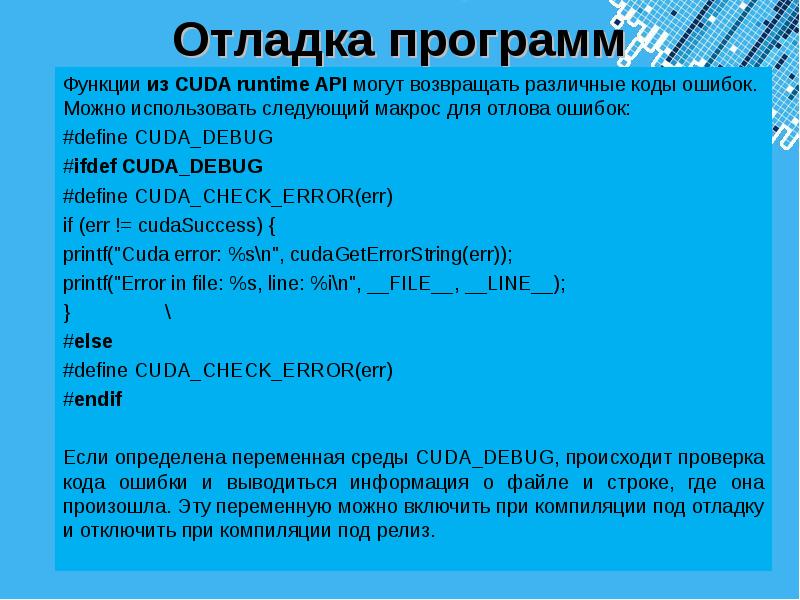

- 8. Отладка программ Функции из CUDA runtime API могут возвращать различные коды

- 9. Типы памяти

- 10. Типы памяти Регистры. Локальная память. Глобальная память. Разделяемая память.

- 11. Организация памяти устройства

- 12. Регистровая память (register) Является самой быстрой из всех видов. Определить количество регистров

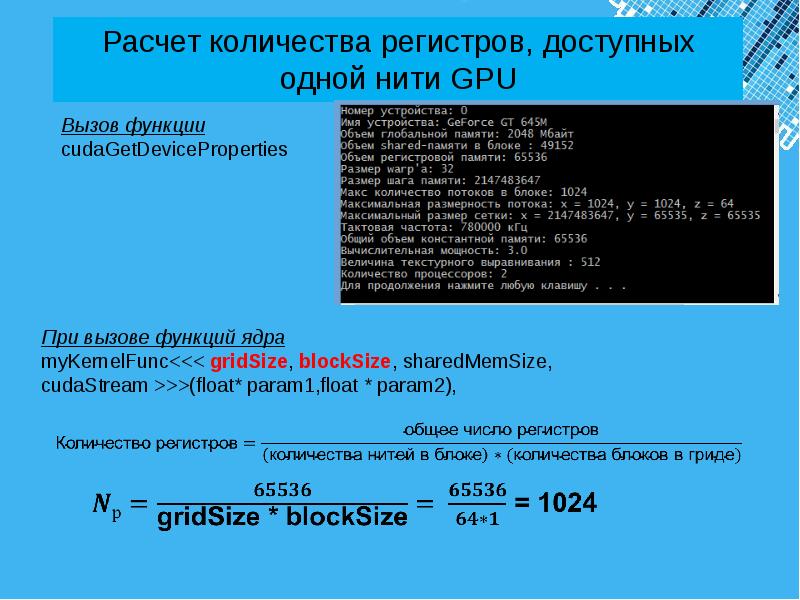

- 13. Расчет количества регистров, доступных одной нити GPU

- 14. Локальная память Локальная память (local memory) может быть использована компилятором при большом количестве

- 15. Глобальная память Глобальная память (global memory) – самый медленный тип памяти, из

- 16. Разделяемая память Разделяемая память (shared memory) относиться к быстрому типу памяти. Разделяемую

- 17. Константная память Константная память (constant memory) является достаточно быстрой из доступных GPU.

- 18. Текстурная память Предназначена главным образом для работы с текстурами. Она оптимизирована

- 19. Пример использования различных типов памяти При операции транспонирования матрицы

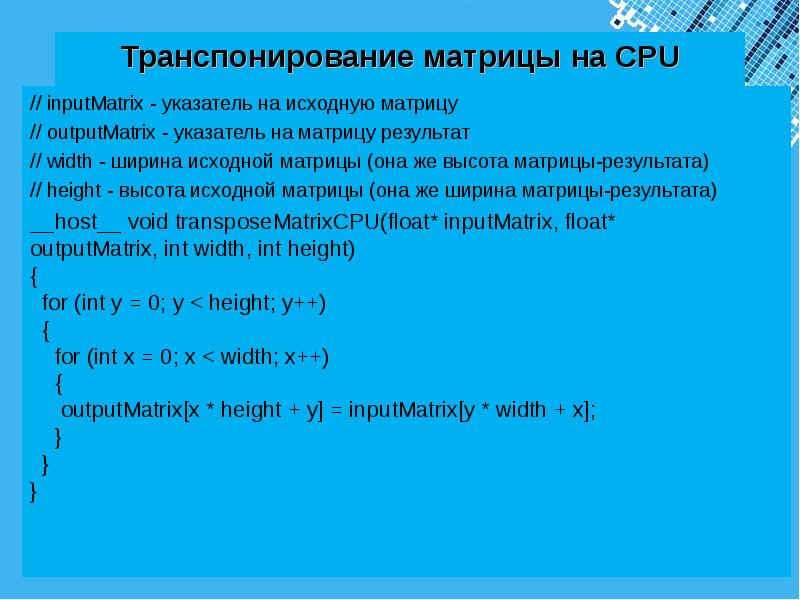

- 20. Транспонирование матрицы на CPU // inputMatrix - указатель на исходную матрицу

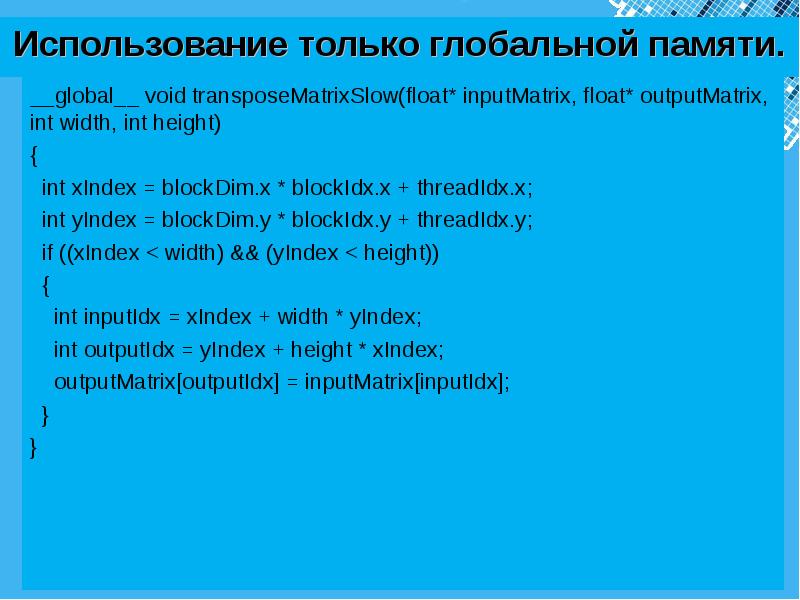

- 21. Использование только глобальной памяти. __global__ void transposeMatrixSlow(float* inputMatrix, float* outputMatrix, int

- 22. Использование константной памяти. #define N 100 __constant__ float devInputMatrix[N]; __global__ void transposeMatrixSlow(float*

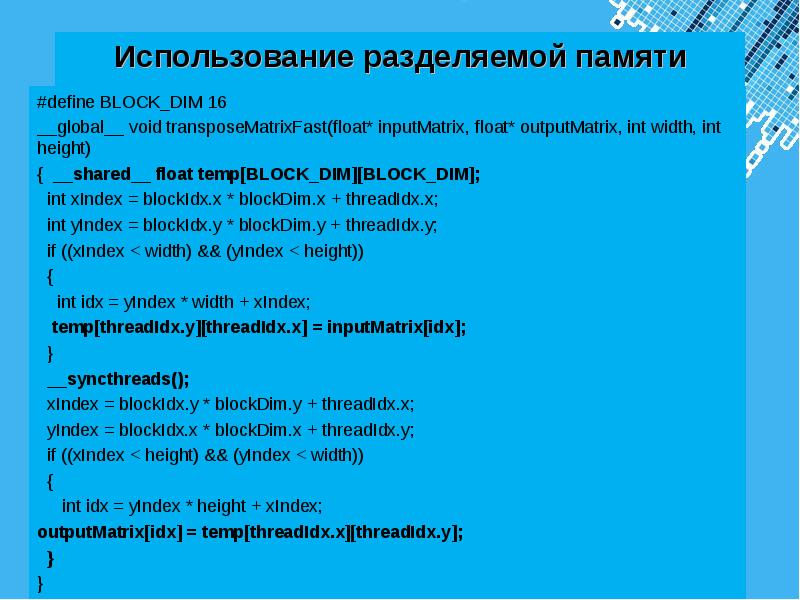

- 23. Использование разделяемой памяти #define BLOCK_DIM 16 __global__ void transposeMatrixFast(float* inputMatrix, float*

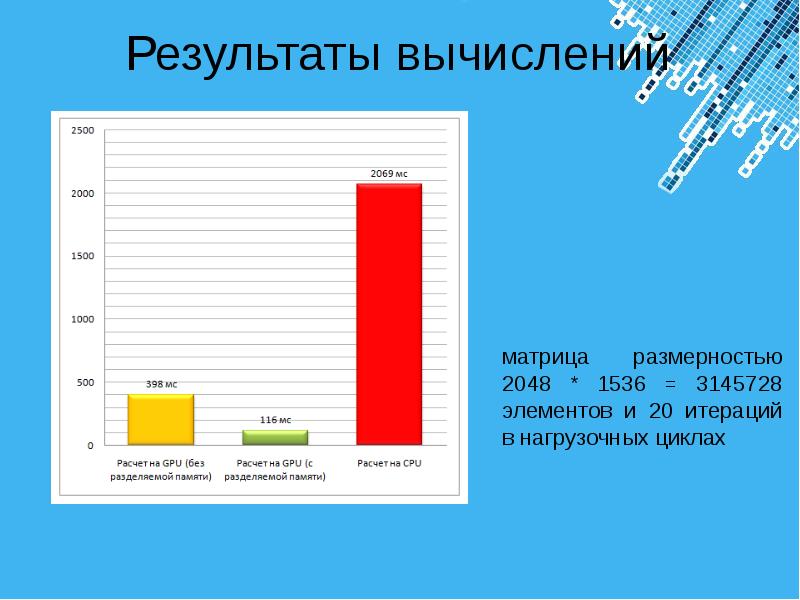

- 24. Результаты вычислений матрица размерностью 2048 * 1536 = 3145728 элементов и

- 26. Скачать презентацию

![Использование константной памяти.

#define N 100

__constant__ float devInputMatrix[N];

__global__ void transposeMatrixSlow(float* Использование константной памяти.

#define N 100

__constant__ float devInputMatrix[N];

__global__ void transposeMatrixSlow(float*](/documents_3/cb9b5d1af2acdcab961d8c71f4e3e15a/img21.jpg)

Слайды и текст этой презентации

Скачать презентацию на тему Основы технологии CUDA. Работа с памятью можно ниже:

Похожие презентации